Architektur der Patientensicherheit

Kognitive Resilienz, Dosierungsfehler und die duale Rolle der Künstlichen Intelligenz in der Akutmedizin

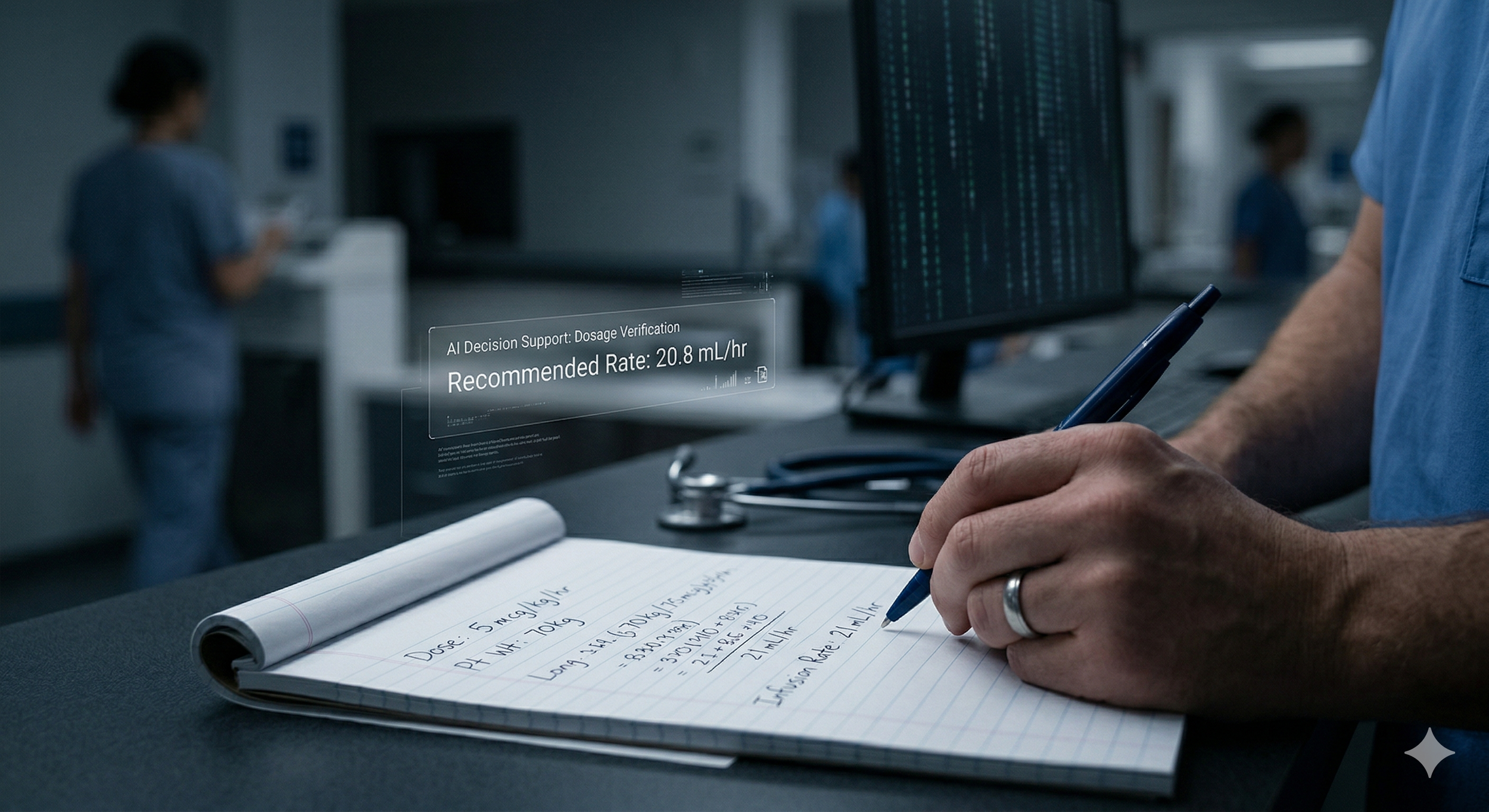

(Symbolbild generiert mit Google Gemini)

Einleitung: Die Grenzen technologischer Verlässlichkeit

Die Sicherheit medikamentöser Therapien zählt zu den zentralen Herausforderungen der Akutmedizin. Insbesondere in der Anästhesiologie, Intensivmedizin, Notfallmedizin und Pädiatrie müssen Dosierungen häufig unter erheblichem Zeitdruck berechnet werden. Bereits minimale Rechen-, Übertragungs- oder Umrechnungsfehler können hier klinisch fatale Konsequenzen nach sich ziehen [1-3].

Mit der zunehmenden Digitalisierung wächst die Erwartungshaltung, dass technische Systeme bzw. „die Künstliche Intelligenz (KI)“ diese Risiken drastisch minimieren [4-6]. Obgleich diese Entwicklung grundsätzlich sinnvoll ist, darf sie nicht dazu führen, dass die Verantwortung für klinische Entscheidungen implizit an Algorithmen delegiert wird. Im Sinne der Patientensicherheit müssen Anwender in der Lage bleiben, technologisch generierte Ergebnisse situativ einzuordnen und kritisch zu verifizieren – denn die Technologie selbst induziert neue, eigenständige Risikokategorien [4-7].

Die Epidemiologie und Phänomenologie des Medikationsfehlers

Um zu verstehen, weshalb Künstliche Intelligenz allein nicht ausreicht, um Fehler verlässlich zu verhindern, bedarf es einer systematischen Betrachtung der Fehlergenese im Medikationsprozess. Fehler manifestieren sich in sämtlichen klinischen Phasen: von der Anamnese über die Verordnung, Dokumentation, Vorbereitung und Verabreichung bis hin zum anschließenden Monitoring.

In der klinischen Praxis stellen Medikationsfehler ein relevantes Problem dar. Arzneimittelbezogene Probleme gelten als häufige Ursache unerwünschter Arzneimittelwirkungen. Je nach Definition und Erhebungsmethode wird in der Literatur ein relevanter Anteil an Krankenhausaufnahmen mit Arzneimittelbezug beschrieben, häufig im Bereich von etwa 5 % und in einzelnen Arbeiten darüber hinaus [8,9]. Auch in Statistiken systematisch erfasster Behandlungsfehler nehmen inkorrekte Pharmakotherapien, insbesondere Dosierungsfehler, einen bedeutsamen Stellenwert ein. Aufgrund unvollständiger Meldesysteme ist zudem von einer erheblichen Dunkelziffer auszugehen [10]. Für die USA wird in der Literatur seit Langem auf die erhebliche klinische Relevanz von Medikationsfehlern hingewiesen. Häufig zitiert wird eine ältere Schätzung von rund 7.000 Todesfällen pro Jahr, die historisch einflussreich war, heute jedoch vor allem als Orientierungswert und nicht als aktuelle Präzisionszahl verstanden werden sollte [11].

Besonders kritisch ist diese Problematik im Kontext der Anästhesiologie zu bewerten. Die dort applizierten Substanzgruppen (z. B. Vasoaktiva, Opioide, Sedativa und Relaxanzien) weisen ein hohes Potenzial für schwerwiegende Komplikationen auf. Gleichzeitig erfolgen Vorbereitung, Berechnung und Applikation oft unter erheblichem Zeitdruck und in hochdynamischen Situationen. Die Literatur beschreibt deshalb für die Anästhesiologie eine besondere Exposition gegenüber Medikationsfehlern und Beinahe-Fehlern. Selbstberichtete Erhebungen unter Mitarbeitenden im Bereich der Anästhesie zeigen, dass ein großer Anteil im Verlauf des Berufslebens mindestens einen Medikationsfehler oder Beinahe-Fehler erlebt [12].

Mathematische Kompetenzdefizite im Alltag

Die weitverbreitete Annahme, dass klinische Erfahrung automatisch vor Rechenfehlern schützt, wird empirisch infrage gestellt. Eine Untersuchung an akademischen Institutionen in den USA dokumentierte bei einem standardisierten Test zur Arzneimittelberechnung eine mittlere Fehlerrate von 17,0 % [13]. Lediglich 20 bis 25 % der teilnehmenden Ärzte erreichten eine fehlerfreie Berechnung. Bemerkenswerterweise korrelierte die Fehlerrate bei Fachärzten sogar schwach positiv mit den Berufsjahren (R = 0,22). Ohne ein gezieltes, fortlaufendes Training (Deliberate Practice) gehen mathematische Fertigkeiten über die Zeit verloren, anstatt sich zu konsolidieren.

-

Häufig wird als Verweis auf das omnipräsente Fehlerpotenzial der lateinische Ausspruch „Errare humanum est“ („Irren ist menschlich“) bemüht – und dabei ironischerweise meist fälschlicherweise Seneca zugeschrieben. Historisch stammt der Satz eher aus Ciceros Philippischen Reden [14]. Dass selbst dieses berühmte Zitat über den Fehler historisch konsequent falsch zugeordnet wird, illustriert bereits das Kernmotiv dieses Beitrags: Der Irrtum ist kein Ausnahmezustand, sondern eine strukturell erwartbare Konstante menschlichen Handelns.

Systematik und Psychologie des Versagens

Klassifizierung medizinischer Fehler (Abbildung generiert mit Google Gemini)

Ein Fehler liegt definitionsgemäß vor, wenn ein angestrebtes Ziel verfehlt wird und die Ursache hierfür nicht auf einem rein zufälligen Ereignis basiert [15]. Zur effektiven Fehlerprävention ist eine Differenzierung zwischen Prozess- und Verhaltensfehlern unerlässlich. Grundlegend wird zwischen beabsichtigten und unbeabsichtigten Verstößen unterschieden:

- Beabsichtigtes Fehlverhalten (Verstöße)

Hierbei führt eine bewusste Entscheidung zum Fehler (z. B. das bewusste Aufziehen von 5%igem Propofol in einer von der Routine abweichenden 20-ml-Spritze). Die Klassifikation umfasst:

- Routine-Verstöße: Gewohnheitsmäßige Abkürzungen etablierter Prozesse.

- Situative Verstöße: Abweichungen, die durch momentane Umgebungsbedingungen erzwungen werden.

- Ausnahme-Verstöße: Handlungen in extremen, seltenen Krisensituationen.

- Sabotage: Die mutwillige Schädigung.

- Unbeabsichtigte Fehler

Diese Kategorien führen im medizinischen Kontext weitaus häufiger zu gravierenden Konsequenzen. Die Cognitive Load Theory (CLT) liefert hierfür den Erklärungsansatz: Wenn das Arbeitsgedächtnis durch eine hohe Aktionsdichte überlastet wird, schaltet das menschliche Gehirn von einem analytischen, langsamen Denken auf automatisierte, fehleranfällige Heuristiken um. Zu diesen Fehlerarten zählen:

- Aufmerksamkeitsfehler („Slips“): Handlungsfehler auf Ausführungsebene (z. B. das Verwechseln von Ampullen).

- Gedächtnisfehler („Lapses“): Erinnerungsdefizite (z. B. das Auslassen eines essenziellen Prozessschritts).

- Regelbasierte Fehler: Die Anwendung einer an sich korrekten Regel in einer dafür ungeeigneten Situation.

- Wissensbasierte Fehler: Handlungen, die aufgrund von fehlendem oder inkorrektem Fachwissen scheitern.

Aus rein medizinisch-pharmakologischer Perspektive fokussiert sich die Praxisprävention vor allem auf Substanzfehler (Verwechslungen), Dosierungsfehler (Über- bzw. Unterdosierungen, Zehnerpotenzfehler), Anwendungsfehler (z. B. falscher Applikationsweg) sowie die Missachtung von Kontraindikationen.

Die menschliche Leistungsfähigkeit wird dabei maßgeblich durch externe Human Factors beeinflusst, die das Fehlerpotenzial substantiell erhöhen können [16]:

- Individuelle Faktoren: Physische Belastbarkeit, Müdigkeit, Stresslevel und aktueller Ausbildungsstand.

- Arbeitsplatzfaktoren: Aufgabenschwierigkeit, mangelnde Routine, fehlende Hilfsmittel, Zeitdruck und auditive/visuelle Ablenkungen.

- Organisationale Faktoren: Ressourcenknappheit, mangelhafte Supervision, hoher Produktionsdruck (z. B. dichte OP-Taktung) und das Fehlen strukturierter Standard Operating Procedures (SOPs).

Höchstes Risiko: Notfälle, Pädiatrie und Interhospitaltransfers

Ein besonders kritisches Risikoprofil entsteht, wenn zur mathematischen Rechenaufgabe externe Stressoren aus den genannten Human Factors hinzukommen. Bei Interhospitaltransfers oder in Akutnotfällen treffen hoher Zeitdruck, fragmentierte Informationslagen und ein enormer Handlungsdruck aufeinander [3,17,18].

Zusätzlich agieren unterschiedliche klinische Teams in diesen Szenarien häufig mit stark abweichenden lokalen Standards (unterschiedliche Medikamentenkonzentrationen, abweichende Laufraten oder eine fremde Geräte-Bedienlogik). Unter kognitivem Stress tendiert der Mensch dazu, bevorzugt auf bekannte Handlungsroutinen zurückzugreifen. Dadurch entsteht ein hohes Sicherheitsrisiko, wenn gewohnte Muster unreflektiert auf eine nicht standardisierte Umgebung übertragen werden. Die Patientensicherheit hängt hier essenziell von der kognitiven Fähigkeit der Teams ab, trotz der Belastung innezuhalten und Ergebnisse aktiv auf ihre Plausibilität zu verifizieren [3,17-19].

Besonders vulnerabel in diesem Kontext ist die Pädiatrie. Hier müssen nahezu sämtliche Dosierungen individuell anhand des stark variierenden Körpergewichts berechnet werden, was die mathematische Komplexität drastisch erhöht [3]. Gefürchtet sind insbesondere Zehnerpotenzfehler. Technische Hilfsmittel wie längenbasierte Notfalllineale reduzieren zwar die initiale Unsicherheit, entbinden das Personal jedoch nicht von der Verpflichtung zur eigenständigen Plausibilitätsprüfung [3].

Künstliche Intelligenz: Assistenz versus Automation Bias

Digitale Systeme leisten unbestritten einen wichtigen Beitrag zur Erhöhung der Patientensicherheit [1,3,19,20]. Auch KI-Systeme erweisen sich als hochgradig nützlich, um kontextbezogene klinische Hinweise zu generieren [4-6].

Eine kritische Grenze wird jedoch überschritten, wenn Künstliche Intelligenz als unfehlbare (Rechen-)Instanz missverstanden wird. Große Sprachmodelle (LLMs) sind primär auf sprachliche Wahrscheinlichkeitsvorhersage und nicht auf formal verifizierte Berechnungen oder regelbasierte Validierung ausgelegt. Daraus resultiert, dass ein KI-generierter Rechenweg sprachlich äußerst souverän und plausibel wirken kann, obwohl zugrunde liegende Rechenschritte, Umrechnungen oder Einheiten fehlerhaft sind [6,7]. Solche Berechnungsfehler werden aufgrund der überzeugenden rhetorischen Darstellung durch den Anwender oft zu spät erkannt [5-7].

Dieses Phänomen beschreibt ein zentrales Problem der digitalen Entscheidungsunterstützung: den sogenannten Automation Bias. Er skizziert die psychologische Tendenz, algorithmischen Empfehlungen blindes Vertrauen entgegenzubringen und eigene Kontrollmechanismen sukzessive abzuschalten [4-6]. Wer algorithmische Berechnungen übernimmt, ohne die Größenordnung und die klinische Plausibilität aktiv gegenzuprüfen, verlagert die medizinische Verantwortung an ein System, das keine belastbare mathematische Sicherheit garantieren kann [5-7].

Langfristig droht dadurch ein relevanter Kompetenzverlust (Deskilling): Wird die kognitive Leistung des Rechnens dauerhaft delegiert, nimmt die Routine in der eigenständigen Überprüfung ab. Spätestens bei Systemausfällen, Medienbrüchen oder in ungewohnten klinischen Settings kann diese Abhängigkeit sicherheitskritisch werden [4-6,17].

Training statt Delegation: Rechenkompetenz ist Sicherheitskultur

Mathematische Basiskompetenz stellt in der Akutmedizin folglich keine vernachlässigbare Nebenfertigkeit dar, sondern ist das Fundament einer professionellen Sicherheitskultur. Nur wer den zugrunde liegenden Rechenweg intellektuell nachvollziehen kann, ist in der Lage, eine fehlerhafte Systemempfehlung als solche zu entlarven [4-7]. Ohne regelmäßige Übung können grundlegende Umrechnungsfähigkeiten insbesondere unter Stress verloren gehen [3,17,21]. Didaktisch fundierte, simulatorische Ansätze sind daher notwendig, um das Verständnis für Rechenwege und pharmakologische Einheiten gezielt zu trainieren [21].

Simulation und Deliberate Practice

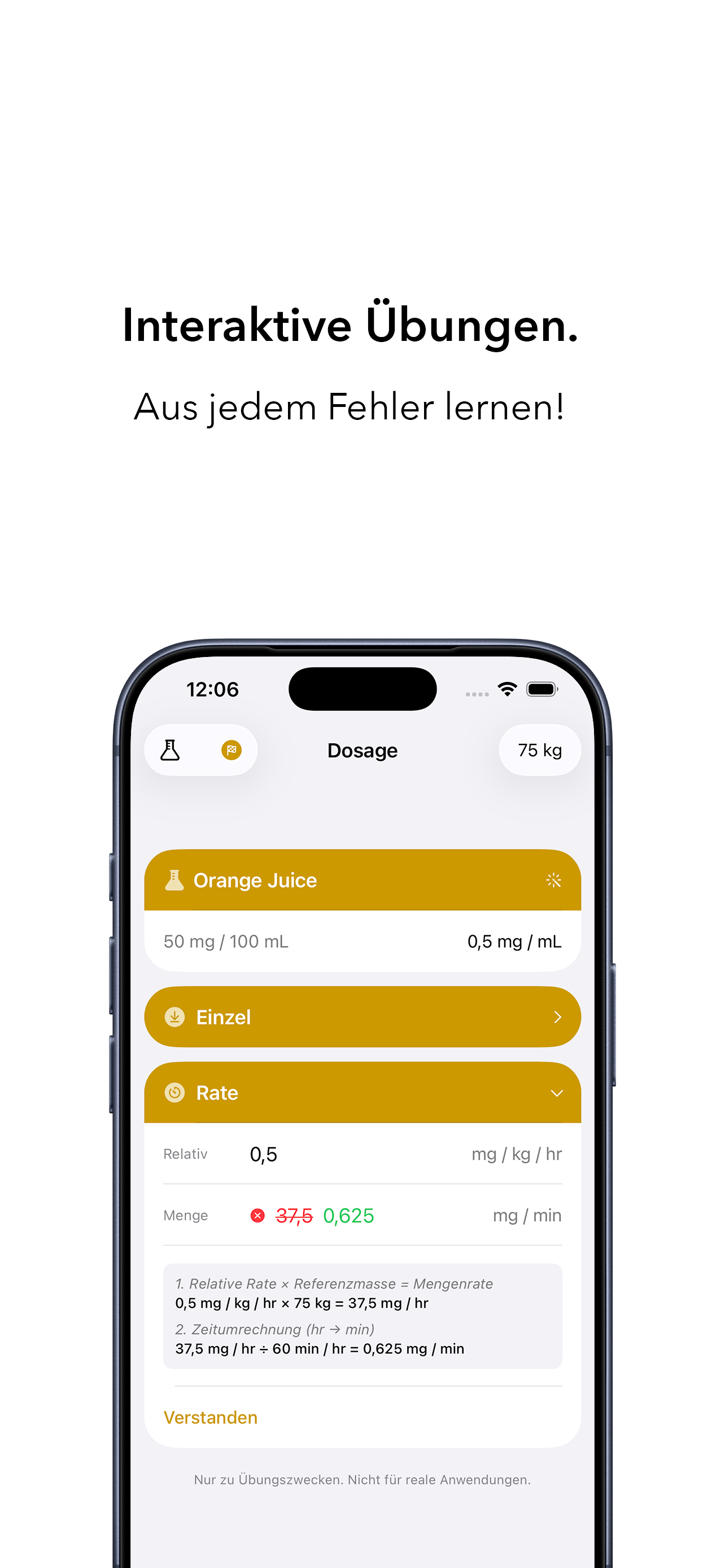

Vor diesem Hintergrund ordnet sich „Dosage“ gemäß seiner expliziten Zweckbestimmung ausschließlich als edukatives Simulations- und Trainingswerkzeug ein. Die Anwendung dient dem Training konzentrationsabhängiger Berechnungen – insbesondere von Volumina, Flussraten und Einheitenumrechnungen – durch gezielte, losgelöste Übung (Deliberate Practice). Ziel ist es, in einem geschützten, risikofreien Kontext genau jene kognitive Resilienz aufzubauen, die in hochdynamischen Akutsituationen vor Fehlern schützt.

Im Zentrum steht dabei die Stärkung der menschlichen Intuition für Größenordnungen und pharmakologische Plausibilität. Gerade in der aktuellen Debatte um digitale Assistenzsysteme und den Automation Bias zeigt sich: Der nachhaltigste Nutzen digitaler Werkzeuge liegt oft nicht darin, dem Behandler das Denken abzunehmen, sondern ihn gezielt darin zu trainieren [4–7,21]. Wer in der Simulation Routine entwickelt, ist im Ernstfall deutlich besser gerüstet, auch algorithmische Empfehlungen kritisch zu hinterfragen.

Transparenzhinweis: Die Anwendung „Dosage“ wurde vom Autor dieses Beitrags entwickelt. Weitere Informationen zur Applikation finden Sie im App Store. Sie ist ausschließlich zu edukativen Zwecken konzipiert und nicht für klinische Zwecke, medizinische Entscheidungen oder die Verwendung in der Patientenversorgung bestimmt.

Fazit

Die Patientensicherheit in einer zunehmend digitalisierten Akutmedizin erfordert ein stringentes Zusammenspiel aus medizinischem Fachwissen, kognitiver Resilienz, klaren IT-Prozessen und einer sinnvoll, aber kritisch eingesetzten Künstlichen Intelligenz. Technologische Innovationen können menschliche Kompetenz wertvoll ergänzen, sie jedoch niemals vollständig ersetzen. Die Fähigkeit, Rechenwege manuell nachzuvollziehen und kritisch auf ihre Plausibilität zu prüfen, stellt keine nostalgische Rückwendung dar. Vielmehr ist sie eine zentrale Sicherheitsvorkehrung gegen die Fehlerquellen einer zunehmend komplexen und störanfälligen technologischen Umwelt.

Literatur

World Health Organization. Medication without harm: policy brief. Geneva: WHO; 2024.

Winterstein AG, Sauer BC, Hepler CD, Poole C. Preventable drug-related hospital admissions. Ann Pharmacother. 2002;36(7-8):1238-1248.

Moyen E, Camiré E, Stelfox HT. Clinical review: medication errors in critical care. Crit Care. 2008;12(2):208.

Tran D, Lee KJ, Tenaglia A, et al. Association of Clinician Diagnostic Performance With Machine Learning–Based Decision Support Systems: A Systematic Review. JAMA Network Open. 2021;4(3):e211276.

Jabbour S, Walsh CG, Lee SI, et al. Measuring the impact of AI in the diagnosis of hospitalized patients: a randomized clinical vignette survey study. JAMA. 2023;330(24):2388-2397.

Khera R, Matheny ME. Automation Bias and Assistive AI: Risk of Harm From AI-Driven Clinical Decision Support. JAMA. 2023;330(23):2255-2257.

Khandekar N, Jin Q, Xiong G, et al. MedCalc-Bench: evaluating large language models for medical calculations. arXiv[Preprint]. 2024:arXiv:2406.12036.

Stausberg J, Hasford J. Drug-related admissions and hospital-acquired adverse drug events in Germany: a longitudinal analysis from 2003 to 2007. BMC Health Serv Res. 2011;11:134.

Arzneimittelkommission der deutschen Ärzteschaft (AkdÄ). Erfassung von Medikationsfehlern in Deutschland – ein Workshopbericht. Arzneiverordnung in der Praxis. 2020;47(1):47-56.

Medizinischer Dienst des GKV-Spitzenverbandes (MDS). Jahresbericht Behandlungsfehler 2022. Essen: MDS; 2023.

Institute of Medicine. To Err Is Human: Building a Safer Health System. Washington, DC: National Academies Press; 2000.

Orser BA, Chen RJB, Yee DA. Medication errors in anesthetic practice: a survey of 687 practitioners. Can J Anaesth. 2001;48(2):139-146.

Black S, Ghaffar S, Siddiqui N, et al. Drug Calculation Errors in Anesthesiology Residents and Faculty: A Cause for Concern? A A Pract. 2019;13(1):12-15.

Cicero MT. Orationes Philippicae in M. Antonium (Philippische Reden). 43 v. Chr.; 12, 5. (Zur fälschlichen Zuordnung zu Seneca siehe auch entsprechende Standardwerke der Zitatforschung, z. B. Büchmann G. Geflügelte Worte).

Reason J. Understanding adverse events: human factors. Qual Health Care. 1995;4(2):80-89.

Vincent C, Taylor-Adams S, Stanhope N. Framework for analysing risk and safety in clinical medicine. BMJ. 1998;316(7138):1154-1157.

Cooper JB, Newbower RS, Long CD, McPeek B. Preventable anesthesia mishaps: a study of human factors. Anesthesiology. 1978;49(6):399-406.

Health and Safety Executive. Managing human failures: overview. London: HSE; 2024.

Deutsche Interdisziplinäre Vereinigung für Intensiv- und Notfallmedizin (DIVI). Empfehlung der DGAI zur farbigen Kennzeichnung von Spritzen / DIVI-Empfehlung Spritzenaufkleber 2012. Berlin: DIVI; 2012.

World Health Organization. Medication Without Harm: WHO Global Patient Safety Challenge. Geneva: WHO; 2017.

McGaghie WC, Issenberg SB, Cohen ER, Barsuk JH, Wayne DB. Does simulation-based medical education with deliberate practice yield better results than traditional clinical education? A meta-analytic comparative review of the evidence. Acad Med. 2011;86(6):706-711.